AI模型損失函數,堪稱讓機器學懂世界的秘密武器,在AI領域,損失函數扮演著至關重要的角色,它衡量著模型預測結果與實際值之間的差異,為模型優化提供了明確的方向,通過不斷調整模型參數,使得損失函數達到最小值,AI模型便能逐漸逼近真實世界的規律,實現精準預測與決策,這一秘密武器的運用,不僅推動了AI技術的飛速發展,更為各行業的智能化轉型提供了強大動力。

嘿,朋友們!今天咱們來聊聊AI模型里一個超級關鍵的東西——損失函數,這玩意兒就像是AI模型的“指南針”,指引著模型往正確的方向學習,讓機器能慢慢“學懂”咱們這個世界。

啥是損失函數?

咱先打個比方哈,就好比你要教一個小孩子認數字,你拿出一張寫著“3”的卡片,跟小孩說這是“3”,可小孩一開始不懂啊,他可能會指著說這是“8”或者別的啥,這時候你就得告訴他,他答錯了,得糾正他,那咋糾正呢?你就得有個標準,告訴他離正確答案差多遠,在AI模型里,損失函數就是這個標準。

損失函數,就是用來衡量模型預測結果和真實結果之間差距的一個函數,模型通過不斷地調整自己的參數,讓損失函數的值越來越小,也就是讓預測結果越來越接近真實結果,就好比那個小孩,經過你一次次地糾正,他慢慢就知道“3”長啥樣了。

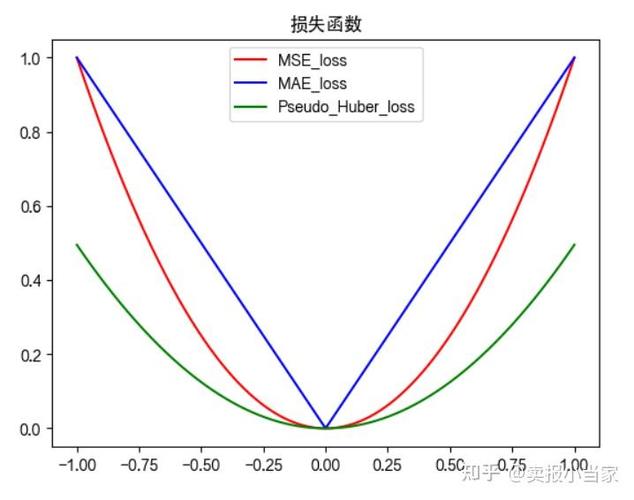

常見的損失函數有哪些?

- 均方誤差損失函數(MSE)

這個可是最常用的損失函數之一,咱還是拿認數字來舉例,假設小孩每次猜的數字和真實數字之間的差,咱都給它平方一下,然后把這些平方差加起來,再除以猜的次數,得到的就是均方誤差,在AI模型里,就是模型預測值和真實值之差的平方的平均值。

比如說,咱有一個預測房價的模型,真實房價是100萬,模型第一次預測是90萬,第二次預測是110萬,那第一次的誤差平方就是$(100 - 90)^2 = 100$,第二次的誤差平方就是$(100 - 110)^2 = 100$,如果就這兩次預測,那均方誤差就是$(100 + 100) \div 2 = 100$,模型就會根據這個損失函數的值,去調整自己的參數,讓下次預測的房價更接近100萬。

- 交叉熵損失函數

這個損失函數在分類問題里特別常用,就好比你要教小孩區分貓和狗,你給小孩看一張貓的圖片,小孩說是狗,那你就得告訴他錯了,這是貓,交叉熵損失函數就是根據模型預測的每個類別的概率和真實類別的概率,來計算它們之間的差距。

比如說,有一張圖片是貓,真實情況是貓的概率是1,狗的概率是0,模型預測貓的概率是0.6,狗的概率是0.4,那交叉熵損失函數就會根據這些概率算出一個值,模型就會根據這個值去調整參數,讓下次預測貓的概率更接近1,狗的概率更接近0。

- 對比損失函數

這個損失函數在一些需要比較相似度的任務里很有用,比如說人臉識別,咱要判斷兩張人臉是不是同一個人,對比損失函數就是讓模型學習如何區分相似的人臉和不同的人臉。

假設有兩張人臉圖片,一張是同一個人的,一張是不同人的,模型會給出一個相似度得分,對比損失函數就會根據這個得分和真實情況(是不是同一個人)來計算損失,如果模型把不同人的臉判斷得很相似,那損失就會很大,模型就會調整參數,讓自己更準確地判斷人臉的相似度。

損失函數是咋影響模型訓練的?

損失函數就像是模型的“教練”,在模型訓練的時候,每次模型給出一個預測結果,損失函數就會算出這個預測結果和真實結果之間的差距,然后模型就會根據這個差距,用一種叫做“梯度下降”的方法去調整自己的參數。

就好比小孩認數字,每次他猜錯了,你就告訴他差多少,然后他會根據這個差距去調整自己的認知,模型也是一樣,它會根據損失函數的值,一點點地調整自己的參數,讓損失函數的值越來越小。

比如說,咱有一個圖像分類模型,一開始它可能把很多圖片都分類錯了,損失函數就會算出這些錯誤分類的損失值,模型就會根據這個值去調整自己的卷積層、全連接層等參數,經過很多次的訓練,損失函數的值越來越小,模型的分類準確率就越來越高。

選對損失函數有多重要?

選對損失函數可太重要了,就好比給小孩找了個好老師,不同的任務需要不同的損失函數,如果選錯了損失函數,模型可能就很難學好。

比如說,對于回歸問題,用均方誤差損失函數就比較合適;對于分類問題,交叉熵損失函數就更常用,要是你在分類問題里用了均方誤差損失函數,模型可能就很難準確地分類。

有時候還需要根據具體的問題對損失函數進行一些改進,比如說,在一些對錯誤分類容忍度不同的任務里,可能需要對交叉熵損失函數進行加權,讓模型更關注某些類別的分類準確率。

實際案例:損失函數在醫療影像診斷中的應用

咱來看看損失函數在實際中的一個應用,就是醫療影像診斷,比如說,醫生要通過X光、CT等影像來判斷病人有沒有患某種疾病,現在咱可以用AI模型來輔助診斷。

在這個任務里,咱就可以用交叉熵損失函數,模型會對每張影像進行預測,判斷病人是患病還是沒患病,真實情況是醫生給出的診斷結果,損失函數就會根據模型的預測結果和真實結果來計算損失。

假設模型把很多本來患病的病人判斷成沒患病,那損失函數的值就會很大,模型就會根據這個值去調整自己的參數,讓自己更準確地診斷疾病,通過不斷地訓練,模型的診斷準確率就會越來越高,就能更好地輔助醫生進行診斷。

AI模型損失函數就像是AI模型的“秘密武器”,它指引著模型往正確的方向學習,讓模型能準確地預測和分類,不同的任務需要不同的損失函數,選對損失函數對模型的性能至關重要。

在實際應用中,我們要根據具體的問題選擇合適的損失函數,甚至對損失函數進行改進,才能讓AI模型更好地為我們服務,在各個領域發揮出更大的作用,就像那個學認數字的小孩,在正確的“教練”(損失函數)的指導下,慢慢就能準確地認出各種數字一樣,AI模型在合適的損失函數的引導下,也能“學懂”這個世界,為我們解決更多的問題。

怎么樣,朋友們,現在對AI模型損失函數是不是有了更深入的了解呢?希望今天聊的這些能對你們有所幫助。

還沒有評論,來說兩句吧...