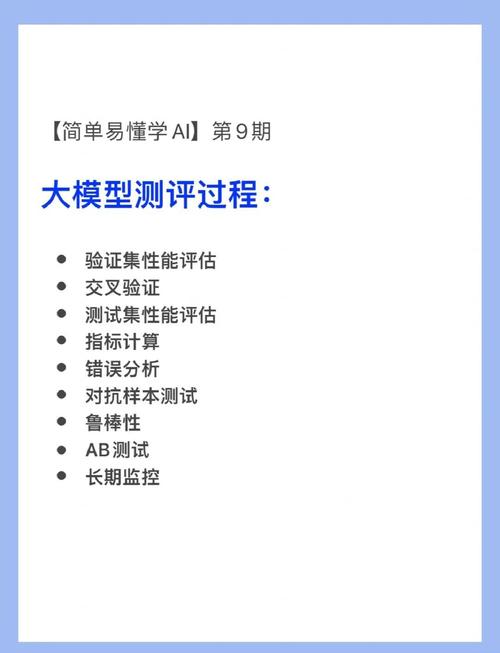

AI模型魯棒性是評估其性能穩定性的關鍵,有效的診斷方法能夠識別模型在面對不同數據或場景時的潛在問題,確保模型的可靠性與準確性,為AI技術的廣泛應用提供堅實保障。

AI模型魯棒性:讓智能系統更“皮實”的秘密武器

嘿,朋友們!今天咱們來聊聊AI模型里一個挺關鍵的概念——魯棒性,你可能會問,啥是魯棒性啊?就是AI模型在面對各種復雜、不確定的情況時,還能保持穩定、準確工作的能力,就像咱們人,身體強壯、抗壓能力強,遇到點小風小浪都不怕,AI模型的魯棒性也是這么個意思。

先給大家舉個例子吧,現在很多智能安防系統都用了AI模型來識別監控畫面里的人和物,要是這個模型的魯棒性不好,那可就麻煩大了,比如說,有一天突然下大雨,監控畫面變得模糊不清,或者有人故意戴著帽子、墨鏡來遮擋面部,再或者光線突然變暗,這時候如果模型不夠“皮實”,就很容易識別錯誤,把好人當成壞人,或者根本識別不出來,那可就影響安全了,但要是模型的魯棒性好,不管遇到啥情況,都能準確地識別出畫面里的內容,這樣就能大大提高安防系統的可靠性。

那AI模型的魯棒性為啥這么重要呢?在實際應用中,AI模型面臨的環境是非常復雜多變的,就拿自動駕駛來說吧,汽車在行駛過程中會遇到各種各樣的天氣條件,晴天、雨天、雪天、霧天,每種天氣對傳感器的數據影響都不一樣,而且道路上還會有各種突發情況,比如突然竄出來的行人、動物,或者前面的車突然急剎車,如果自動駕駛系統的AI模型魯棒性不足,就可能出現誤判,導致嚴重的安全事故,提高模型的魯棒性,就是保障我們的生命安全。

從商業角度來看,魯棒性好的AI模型能為企業帶來更大的價值,比如說,電商平臺用AI模型來推薦商品,如果模型的魯棒性不好,可能因為用戶的一些特殊行為,比如突然改變購買習慣、搜索一些不常見的商品,就導致推薦不準確,影響用戶的購物體驗,進而降低用戶的忠誠度,而魯棒性好的模型,就能更好地適應用戶的各種變化,提供更精準的推薦,提高用戶的購買轉化率,為企業帶來更多的收益。

那怎么才能提高AI模型的魯棒性呢?這可有不少辦法,其中一個重要的方法就是數據增強,就像我們人要通過不斷鍛煉來增強體質一樣,AI模型也需要通過大量的數據來“鍛煉”自己,數據增強就是在原有的數據基礎上,通過一些技術手段生成更多的數據,比如說,對于圖像數據,可以進行旋轉、翻轉、縮放、添加噪聲等操作,讓模型在不同的圖像變化下都能準確識別,這樣一來,模型就能更好地適應各種實際情況,提高魯棒性。

還有一個方法是引入對抗訓練,對抗訓練就像是給模型找一個“對手”,這個“對手”會故意制造一些干擾,讓模型出錯,然后模型就在不斷地和“對手”的對抗中學習,提高自己的抗干擾能力,比如說,在圖像識別中,可以生成一些對抗樣本,這些樣本看起來和正常樣本很像,但會讓模型識別錯誤,模型通過不斷地學習這些對抗樣本,就能逐漸提高自己的魯棒性,在面對真正的干擾時也能準確識別。

模型的架構設計也很重要,一個好的架構就像是一座堅固的房子,能更好地抵御各種“風雨”,研究人員會設計一些具有特殊結構的模型,比如卷積神經網絡(CNN)在處理圖像數據時就有很好的魯棒性,因為它能自動提取圖像的特征,對圖像的平移、旋轉等變化不敏感。

AI模型的魯棒性是AI技術發展中一個非常重要的方面,它關系到AI系統能否在實際應用中穩定、可靠地工作,隨著AI技術的不斷發展,我們對模型魯棒性的要求也會越來越高,相信會有更多的方法和技術來提高AI模型的魯棒性,讓AI更好地服務于我們的生活和工作,就像我們期待一個強壯、健康的人能承擔更多的責任一樣,我們也期待魯棒性更好的AI模型能為我們帶來更多的驚喜和便利。