AI模型語言建模任務:從基礎到前沿的探索之旅

嘿,朋友們,今天咱們來聊聊一個聽起來高大上,但其實跟咱們日常生活越來越緊密的話題——AI模型語言建模任務,你可能覺得這詞兒挺拗口,就是讓電腦學會像人一樣理解和生成語言,想象一下,你的手機能跟你聊天,幫你寫郵件,甚至創作詩歌,這背后就是語言建模技術在發揮作用。

咱們先從最基礎的說起,語言建模,就是給計算機一個任務:根據給定的文本,預測下一個詞或者句子會是什么,這聽起來簡單,但做起來可不容易,就像咱們學說話,得先聽,再模仿,最后才能自己組織語言,計算機也是一樣,它得先“讀”大量的文本,學習語言的規律,然后才能“說”出合理的話來。

舉個例子,咱們小時候學說話,父母會指著蘋果說:“這是蘋果。”慢慢地,咱們就學會了“蘋果”這個詞,并且知道它指的是那個紅紅的、甜甜的水果,計算機學語言也是類似的道理,只不過它“讀”的是海量的網頁、書籍、文章,通過算法分析這些文本中的詞匯、語法、語境,來構建自己的語言模型。

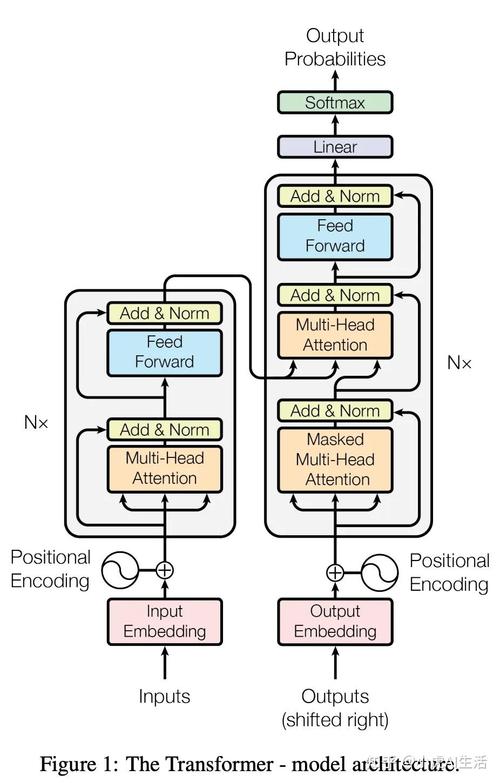

隨著技術的發展,語言建模任務不再局限于簡單的詞匯預測,而是進化到了更高級的階段,比如生成連貫的段落、文章,甚至是對話,這時候,AI模型就得具備更強的“理解力”和“創造力”,現在流行的聊天機器人,它們不僅能回答你的問題,還能根據你的語氣和上下文,給出恰當的回應,這背后就是深度學習模型,特別是Transformer架構的功勞。

Transformer架構,聽起來挺復雜,其實它的核心思想就是“注意力機制”,就是讓模型在處理文本時,能夠“關注”到最重要的部分,而不是平均用力,當你說“我想吃蘋果”時,模型應該更關注“蘋果”這個詞,而不是“我想吃”,這種機制讓模型在處理長文本時更加高效,也更能捕捉到文本中的細微差別。

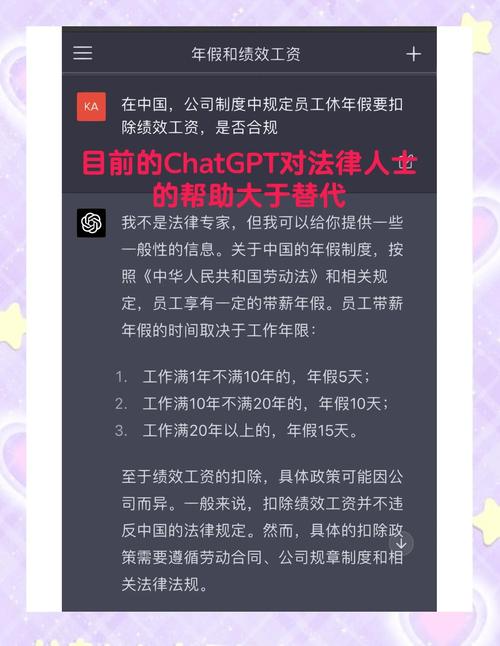

說到這,不得不提一下GPT系列模型,這可是語言建模領域的明星產品,從GPT-1到GPT-4,每一次迭代都帶來了巨大的進步,GPT-4不僅能生成流暢的文章,還能進行復雜的邏輯推理,甚至在某些任務上表現出了接近人類的水平,它能根據一段描述,創作出富有想象力的故事,或者根據給定的條件,生成合理的解決方案。

語言建模任務的應用遠不止于此,在翻譯領域,AI模型能夠快速準確地將一種語言翻譯成另一種語言,大大提高了跨語言交流的效率,在教育領域,智能輔導系統能夠根據學生的學習情況,提供個性化的學習建議和輔導,在醫療領域,AI模型還能輔助醫生進行疾病診斷,通過分析患者的病歷和癥狀,給出可能的診斷結果和治療建議。

語言建模任務也面臨著不少挑戰,如何讓模型更好地理解語言的情感色彩?如何避免模型生成帶有偏見或歧視性的內容?如何提高模型的效率和可解釋性?這些都是科研人員正在努力解決的問題。

就拿情感理解來說吧,咱們說話的時候,往往帶著各種情感,比如高興、悲傷、憤怒,計算機要想真正“聽懂”咱們的話,就得學會識別這些情感,這可不是一件容易的事,因為情感往往隱藏在語言的細微之處,比如語氣、用詞、語境等,科研人員正在嘗試通過引入情感詞典、情感分析算法等方法,來提高模型對情感的理解能力。

再來說說偏見和歧視的問題,由于訓練數據往往來源于現實世界,而現實世界中存在著各種偏見和歧視,因此模型在訓練過程中可能會不自覺地學習到這些偏見,某些模型在生成文本時,可能會對某些群體產生不公平的描述,為了解決這個問題,科研人員正在努力開發更加公平、透明的算法,以及更加多樣化的訓練數據集。

至于效率和可解釋性,這也是語言建模任務中不可忽視的問題,隨著模型規模的擴大,訓練和推理的成本也在不斷增加,由于深度學習模型的復雜性,人們往往難以理解模型是如何做出決策的,為了提高效率和可解釋性,科研人員正在探索各種優化方法,比如模型壓縮、知識蒸餾、可解釋性算法等。

AI模型語言建模任務是一個充滿挑戰和機遇的領域,它不僅讓計算機變得更加智能,也為咱們的生活帶來了諸多便利,隨著技術的不斷進步,咱們有理由相信,語言建模任務將會在更多領域發揮重要作用,為咱們創造更加美好的生活。

朋友們,下次當你跟聊天機器人聊天,或者看到AI生成的精彩文章時,不妨想一想,這背后是多少科研人員的辛勤付出和智慧結晶,語言建模任務,這個看似高深莫測的領域,其實正悄悄地改變著咱們的世界,咱們就拭目以待,看看它未來還會帶來哪些驚喜吧!