AI模型魯棒性至關重要!當模型出現故障別慌張,掌握有效故障排查方法是關鍵,深入剖析問題根源,精準定位故障點,讓AI模型穩定運行,發揮強大效能。

AI模型魯棒性:讓智能更可靠的關鍵所在

現在這年頭,AI(人工智能)已經滲透到咱們生活的方方面面了,從手機里的語音助手,到自動駕駛汽車,再到醫療診斷系統,AI的身影無處不在,但你有沒有想過,這些看似無所不能的AI模型,其實也有它們的“軟肋”?今天咱們就來聊聊AI模型魯棒性這個話題,看看它是怎么讓AI變得更可靠的。

啥是AI模型魯棒性呢?就是AI模型在面對各種復雜、多變甚至帶有噪聲的數據時,還能保持穩定、準確輸出的能力,就像咱們人一樣,遇到點風吹草動,有的人就慌了神,有的人卻能穩如泰山,AI模型的魯棒性,就是衡量它能不能像后者那樣,在各種環境下都能“穩如老狗”。

為啥AI模型魯棒性這么重要呢?你想啊,如果自動駕駛汽車在遇到惡劣天氣或者復雜路況時,AI模型就“懵圈”了,那后果可不堪設想,再比如,醫療診斷系統如果因為數據的一點小波動就給出錯誤的診斷,那可是會耽誤病情的,提高AI模型的魯棒性,就是讓AI在各種情況下都能“不掉鏈子”,給咱們的生活帶來更多的便利和安全。

怎么提高AI模型的魯棒性呢?這可不是一件簡單的事兒,得從多個方面入手。

第一招,就是數據增強,咱們都知道,AI模型是靠數據“喂”出來的,數據越多、越多樣,模型就越聰明,但光有數量還不夠,質量也得跟上,數據增強就是通過對原始數據進行各種變換,比如旋轉、縮放、裁剪、添加噪聲等,來生成更多樣化的數據,這樣一來,AI模型在訓練時就能接觸到更多不同的情況,遇到新情況時也就不容易“懵圈”了。

舉個例子吧,比如咱們要訓練一個識別貓狗的AI模型,如果只用一些正面、清晰、光線好的貓狗圖片來訓練,那模型可能就只能認出這種“標準”的貓狗,但如果咱們用數據增強的方法,給圖片加上各種濾鏡、調整光線、甚至把貓狗P到不同的背景上,那模型就能學到更多關于貓狗的特征,遇到各種奇形怪狀的貓狗圖片也能認出來了。

第二招,就是模型正則化,這聽起來有點高大上,其實原理很簡單,就是咱們在訓練AI模型的時候,給它加上一些“規矩”,讓它不要學得太“過火”,咱們可以限制模型的參數大小,或者讓模型在訓練時更加關注那些對結果影響大的特征,而不是被一些無關緊要的細節給帶偏了,這樣一來,模型就能更加穩健地學習,遇到新情況時也能更好地應對。

再舉個例子,比如咱們要訓練一個預測房價的AI模型,如果模型學得太“過火”,可能會把一些偶然的因素,比如某個小區突然來了個大明星,導致房價上漲,也當成是普遍規律,但如果咱們用模型正則化的方法,讓模型更加關注那些長期、穩定的因素,比如地理位置、房屋面積、周邊設施等,那模型就能更加準確地預測房價了。

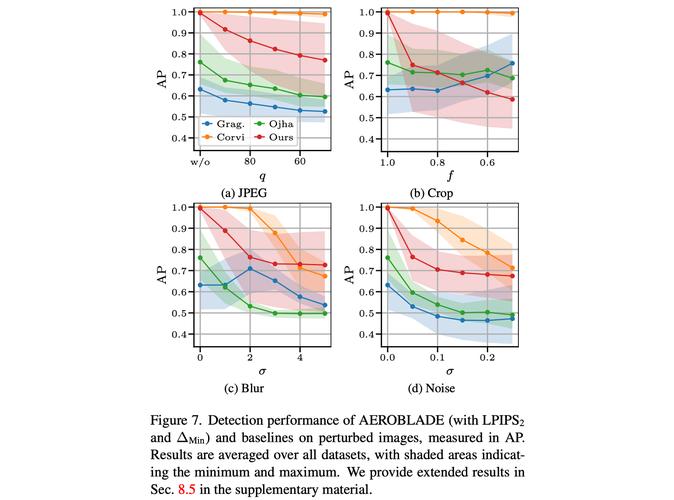

第三招,就是對抗訓練,這可是提高AI模型魯棒性的“殺手锏”,對抗訓練就是故意給AI模型制造一些“難題”,比如給它看一些經過精心設計的、能騙過它的圖片或者數據,讓它學會怎么識別并應對這些“陷阱”,這樣一來,AI模型在遇到真正的難題時,就能更加從容不迫地應對了。

在圖像識別領域,就有人專門設計了一些對抗樣本,這些樣本在人類看來和正常圖片沒啥區別,但卻能讓AI模型“看走眼”,通過對抗訓練,AI模型就能學會怎么識別這些對抗樣本,提高自己的魯棒性。

當然啦,提高AI模型魯棒性可不是一朝一夕的事兒,得持續不斷地努力,隨著AI技術的不斷發展,新的挑戰和問題也會不斷涌現,但只要咱們掌握了正確的方法,不斷探索和實踐,就一定能讓AI模型變得更加可靠、更加智能。

我想說,AI模型魯棒性不僅僅是技術問題,更是責任問題,咱們開發AI模型,是為了讓生活變得更好,而不是為了制造麻煩,在追求AI模型性能的同時,咱們也得時刻關注它的魯棒性,確保它在各種情況下都能穩定、準確地運行,這樣,咱們才能真正享受到AI帶來的便利和福祉。

AI模型魯棒性是讓智能更可靠的關鍵所在,只有不斷提高AI模型的魯棒性,咱們才能讓AI在更多領域發揮更大的作用,為咱們的生活帶來更多的驚喜和改變,讓我們一起努力,讓AI變得更加智能、更加可靠吧!

還沒有評論,來說兩句吧...